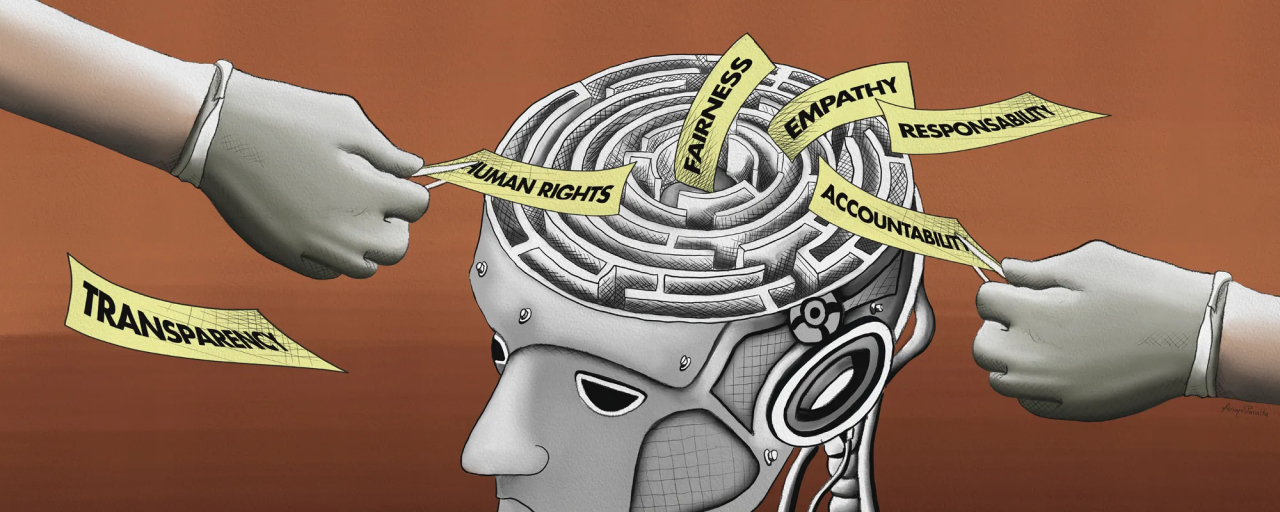

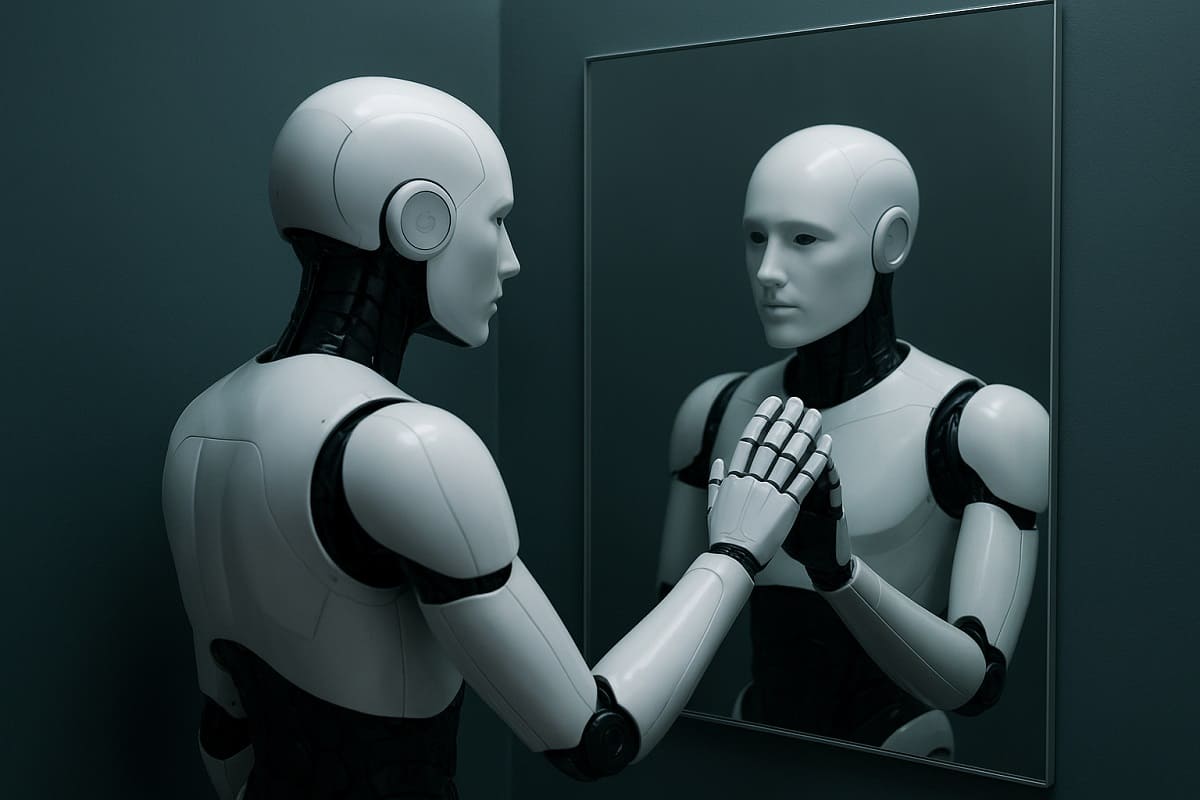

En el campo de la Inteligencia Artificial (IA) , la ética y la responsabilidad están estrechamente relacionadas, pero no son lo mismo . La ética en la IA se refiere a los principios que orientan su diseño y uso, como la equidad, la transparencia, el respeto a la privacidad y la no discriminación. Estos principios buscan responder a la pregunta: ¿debería hacerse? La responsabilidad , en cambio, se centra en ¿quién responde y asume las consecuencias cuando una IA genera impactos negativos o decisiones incorrectas?

Desde una perspectiva social, una IA ética evita reforzar estereotipos o excluir a ciertos grupos. Sin embargo, la responsabilidad aparece cuando desarrolladores, empresas o instituciones se hacen cargo de los efectos reales de la tecnología en la vida de las personas, por ejemplo, corrigiendo sesgos o reparando daños. No basta con que una IA sea diseñada con valores éticos si no existe alguien que responda por su uso.

En el plano ambiental , la ética cuestiona el alto consumo energético de algunos sistemas de IA y su impacto en el planeta. La responsabilidad implica tomar decisiones concretas para reducir esa huella, como optimizar recursos o usar energías sostenibles. De nuevo, pensar éticamente no garantiza actualmente responsable.

En el ámbito económico , la ética analiza cómo la IA afecta el empleo, la distribución de la riqueza y el acceso a oportunidades. La responsabilidad exige implementar políticas y acciones que acompañen estos cambios, protegiendo a las personas más vulnerables frente a la automatización.

En conclusión, la ética orienta, pero la responsabilidad actúa . En la IA, no es suficiente con hablar de principios si no se asumen compromisos reales frente a sus consecuencias.

Y tú, ¿has usado Inteligencia Artificial?

Recommended3 dieron "Me gusta"Publicado en Inteligencia artificial

Comentarios